20亿美元估值巅峰 “欧洲版OpenAI”如何成为GPT最强对手?

“元宇宙的开拓者”是我们针对元宇宙的发展而设立的专栏,主要面向那些深挖元宇宙产业或者在元宇宙进行“淘金”的从业者,分享这些企业或者创业者们的故事,以独特的视角窥见那些引领全球元宇宙发展的企业或个人,我们深信元宇宙的大幕已经拉开,引领未来20年的科技互联网已经走上了时代浪潮。估值20亿,挑战OpenAI霸主地位,Mistral AI的崛起如何改变大语言模型格局?以下是我们的第62期内容,以下Enjoy。

“ChatGPT像互联网发明一样重要,将会改变世界。”比尔·盖茨对于大模型的预判似乎正在一步步成为现实。

在过去的一年里,OpenAI在AI(人工智能)领域独领风骚,无论是ChatGPT的普及,还是其内部的风波,都成为了业界的焦点。

然而,随着Mistral AI的崛起,这一格局正在经历前所未有的变革。

作为OpenAI的强劲对手,Mistral AI在技术和产品层面均展现出令人瞩目的突破,已然成为AI领域的一颗耀眼明星,被称作“欧洲版OpenAI”。

与OpenAI相比,Mistral AI更加注重技术的实际应用,致力于将最先进的AI技术应用于解决实际问题。

在融资方面,Mistral AI在成立之初便获得了1.13亿美元的种子轮融资,并吸引了多家著名投资机构,如Lightspeed Venture Partners、Salesforce和法国巴黎银行等。

在短短几个月内,该公司又完成了4.15亿美元的A轮融资,估值高达20亿美元。这一融资规模在AI初创公司中极为罕见,不仅证明了资本市场对Mistral AI的高度认可和期待,也为其未来的发展提供了强大的资金支持。

Mistral AI的崛起,不仅对OpenAI构成了挑战,更为整个AI领域注入了新的活力,为整个行业带来了更多的创新与突破。

01.引领人工智能革命的创新力量

Mistral AI全名为Mistral Artificial Intelligence,是一家专注于AI研发和应用的公司,尤其是用于构建在线聊天机器人、搜索引擎和其他AI驱动产品的技术。

自成立以来,Mistral AI一直坚持以人为本,他们希望通过开发更加智能、更加人性化的AI系统,改善人们的生活和工作方式,为人类带来更多的便利和福祉,致力于利用先进的AI技术为各行各业提供高效、智能的解决方案。

尽管只是一家初创企业,但Mistral AI的创始人团队个个来头不小。

其中,Arthur Mensch曾担任谷歌人工智能公司DeepMind的研究员,Timothée Lacroix和Guillaume Lample则分别在Meta公司担任与该技术相关的职位。

曾经的工作经历让他们对多模态、RAG、算法优化等技术有着深刻理解,并在模型推理、预训练和模型嵌入等领域有着深入研究。

Mistral AI官网上的这段话充分展现了Mistral AI的野心:“我们的使命是推动AI向前发展,为开放社区和我们的企业客户服务。我们致力于通过开发与专有解决方案不相上下的开放式重量模型来推动AI革命。”

尽管Mistral AI目前只是小型创意团队,但他们始终坚持高科学标准,并通过突破性的创新来开发高效、有用和值得信赖的AI模型。这或许正是Mistral AI备受青睐的原因之一。

02.大语言模型的重大飞跃

Mistral AI最备受瞩目的产品无疑是Mixtral 8x7B,这是目前市场上最具竞争力的开放式大型模型之一,拥有多项特别的功能,性能明显领先于其它大模型。

Mixtral 8x7B的核心在于其创新性十足的MoE(Mixture of Experts)架构,MoE架构通过一个网关网络,将输入数据分配给被称为“专家”的特定神经网络组件。在Mixtral 8x7B中,共有八个这样的专家,每个都有着高达70亿的模型参数。

尽管配备了八个“专家”,但在实际运算时每个数据处理仅需两个“专家”参与。这种数据资源分配算法,极大地在保持模型性能的同时,优化了处理速度,同时保持了模型性能。

在培训和微调方面,Mixtral AI使用多语言数据进行预训练,包括英语、法语、意大利语、德语和西班牙语。Instruct模型使用监督微调和直接偏好优化(DPO)进行训练,在MT-Bench等基准测试中取得了高分。

在对Mixtral 8x7B进行深入研究时,Mistral AI也十分注重对其部分功能进行微调,特别是针对那些能够跟随指令操作的版本,使得模型朝着更加精细化和个性化的方向发展。

除了自身的超强性能以外,Mixtral 8x7B广受好评的另一个重要原因是它所代表的开放性。

Mistral AI在发布这一大模型时便直接公开了这个模型的权重数据,这种策略在吸引AI社区的注意力方面非常有效,同时确保了学术和商业用途的广泛可访问性。Mixtral AI的开放性鼓励着多样化应用的出现,有可能在大模型和语言理解方面带来新的突破。

Mixtral 8x7B的创新方法和卓越性能使其成为大模型领域的行业标杆,尽管已经取得如此成就,Mixtral AI也从未停下前进的步伐,依然在积极优化这一模型的相关性能。

03.Mistral AI的里程碑式发展

Mixtral 8x7B的诞生标志着AI技术的一个重要突破,尤其是在模型结构和效率上的创新,那么和一众大模型比起来它又表现如何?

能否超越巨头?

自ChatGPT问世以来,OpenAI一直被视为大语言模型的黄金标准。然而,Mistral AI通过引入一个完全开源的开放权重模型,在广泛的基准测试中表现出卓越的性能,甚至在部分表现上超越了OpenAI的GPT 3.5模型和Meta的LLama 2 13B模型。

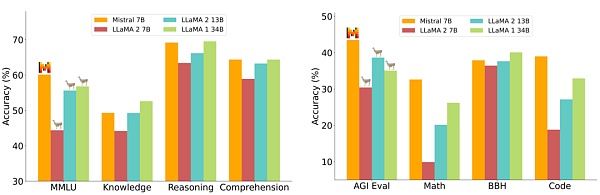

具体而言,在多领域的大规模多任务语言理解(MMLU)测试中,涵盖数学、美国历史、计算机科学、法律等57个科目,Mistral AI以60.1%的准确率脱颖而出,而Llama 2 7B和Llama 2 13B的准确率分别略高于44%和55%。

同样,在涉及常识推理和阅读理解的测试中,Mistral 7B的表现优于这两个Llama模型,准确率分别为69%和64%,凸显了其在深度语言理解领域的优势。

Mistral 7B之所以在深度语言理解方面表现优秀,是因为在训练过程中接触到了大量复杂、多变的文本数据,增强了其语境感知和推理能力,使得Mistral 7B在测试时能够更好地理解和把握文本的内在逻辑和语义信息,从而给出更准确、更深入的回答。

与GPT3相较而言,Mistral AI聚焦于快速推理和处理更长的序列。利用分组查询和滑动窗口注意力机制——基于注意模型的一种注意模式,实现了对更低的延迟和更高吞吐量的优化。这使其适用于以更低的成本实现大批量、快速加工的应用场景,成为节约成本效益的最佳选择。

对比之下,GPT3以其深入语言理解能力和多任务处理能力而闻名,并且它被优化用于处理更短的序列。例如GPT3在问答系统任务中表现出色,能够理解和生成准确的答案;得益于强大的语言理解能力,它能够快速地总结长篇文本;另外GPT3还可以执行文本补全、语言翻译、情感分析等。

高性能小型模型,但缺乏“安全护栏”

Mistral 7B以其高性能和强适应性备受关注,具有“小数字足迹”的特点,即模型在运行时所需的计算资源和存储空间较少。

相较于其他对强大硬件严格依赖的模型,Mixtral 7B甚至可以在没有独立GPU的小型个人电脑上运行。这使得其可以灵活运用部署工具,如vLLM推理服务器和skypilot开源框架等部署在任何云平台上,包括AWS、GCP和Azure。同时,该模型也支持与开发人员提供的参考实现在本地协同使用。

尽管其高性能和灵活部署的能力突出,安全性却成为Mistral AI的漏洞之处。

GPT3和Llama 2等LLM模型具有严格的内容过滤器,可以拒绝生成母公司认定为有害的消息,Mixtral 7B却缺乏这一“安全护栏”。曾有用户向Mistral AI的问答模型询问如何制造炸弹和实施谋杀,其聊天机器人竟然给出了细思极恐的细节指导。

尽管Mistral AI团队致力于开放分享其技术,但这可能成为其AI产品的一把双刃剑,因为监管机构可能会因其缺乏传统内容过滤器而对该模型采取更严厉的措施。

另一方面,Mistral AI的CEO Arthur Mensch曾在AI安全峰会上表示:“开源带来的风险和益处之间存在一种权衡,我们需要通过动态的对话来寻找最佳解决方案。”

据悉,该公司正在构建一个具备模块化过滤器和模块化机制的平台,用于管理模型网络。也许,该公司将从模型内部构建方面,着手AI安全和防护问题。

在如今竞争激烈的大语言模型中,Mistral AI凭借其卓越的性能和出色的适应性脱颖而出。然而,面临潜在的AI安全性挑战,行业人员也正思考如何在开源与安全之间取得权衡之道。

04.与谷歌云共创智能未来

众所周知,谷歌云在全球云计算领域堪称佼佼者,而当它与AI领域的黑马Mistral AI相遇,一个充满无限可能的未来正逐渐展现在我们眼前。

上个月,谷歌云宣布和Mistral AI建立全球合作伙伴关系,Mistral AI将使用谷歌云的基础设施来分发和商业化其大型语言模型。

借助谷歌云强大的云计算和大数据技术,Mistral AI在模型推理、预训练等领域有望取得前所未有的突破。这不仅将进一步推动AI技术的发展,更将为各行业带来更为智能、高效的解决方案。

与此同时,双方的合作也将加速Mistral AI在各个行业的落地应用。无论是电商、金融、医疗还是教育,Mistral AI都将为人类带来更多便利和福祉。

当然,Mistral AI的崛起并非偶然。作为一家充满活力和创新精神的公司,Mistral AI始终致力于探索AI技术的边界,并将其应用于解决实际问题。

其出色表现和创新能力,使得人们不禁开始思考:这家初创公司是否有可能超越OpenAI,成为欧洲AI领域的领军者?让我们拭目以待。

【声明】:本文为元宇宙之心运营团队原创,未经允许严禁转载,如需转载请联系我们,文章版权和最终解释权归元宇宙之心所有。

来源:金色财经

交易商排行

更多- 监管中EXNESS10-15年 | 英国监管 | 塞浦路斯监管 | 南非监管88.77

- 监管中FXTM 富拓10-15年 |塞浦路斯监管 | 英国监管 | 毛里求斯监管85.36

- 监管中GoldenGroup高地集团澳大利亚| 5-10年85.87

- 监管中金点国际集团 GD International Group澳大利亚| 1-2年86.64

- 监管中Moneta Markets亿汇澳大利亚| 2-5年| 零售外汇牌照80.52

- 监管中IC Markets10-15年 | 澳大利亚监管 | 塞浦路斯监管91.71

- 监管中CPT Markets Limited5-10年 | 英国监管 | 伯利兹监管91.56

- 监管中GO Markets高汇15-20年 | 澳大利亚监管 | 塞浦路斯监管 | 塞舌尔监管87.90

- 监管中alpari艾福瑞5-10年 | 白俄罗斯监管 | 零售外汇牌照87.05

- 监管中AUS Global5-10年 | 塞浦路斯监管 | 澳大利亚监管86.47